Human Machine Interfaces im Off-Highway-Einsatz sorgen für mehr Produktivität und Sicherheit

Intuitiv von Beginn an

Mit Blick auf die SYSTEMS & COMPONENTS 2025 zeigt sich: Die zunehmende Konnektivität und Automatisierung im Off-Highway-Bereich beeinflusst die Interaktion zwischen Mensch und Maschine: Die "ideale" Mensch-Maschine-Schnittstelle, das Human Machine Interface (HMI), unterstützt den Fahrer und versorgt ihn mit den richtigen Informationen zur richtigen Zeit. Kamera- und Radarsysteme, wie sie vom 9. bis 15. November in Hannover präsentiert werden, erleichtern dabei die Rundumsicht und können die Sicherheit erhöhen. Und auch die erweiterte Realität (XR) hält Einzug in die Assistenzsysteme und HMI-Lösungen für mobile Arbeitsmaschinen.

„Mobile Arbeitsmaschinen müssen in einer rauen und sich ständig ändernden Umgebung zuverlässig arbeiten können. Dabei führen sie Aufgaben aus, welche die höchste Aufmerksamkeit des Bedieners erfordern“, sagt Petra Kaiser von der DLG (Deutsche Landwirtschafts-Gesellschaft). Autonome Funktionen stellen für Kaiser dabei eine große Unterstützung für die Bediener dar. „Sie führen zu einer deutlichen Arbeitserleichterung, während gleichzeitig die Kontrolle beim Maschinenführer verbleibt“, so Kaiser, die seit Dezember 2024 als Brand Managerin die SYSTEMS & COMPONENTS betreut – den führenden Branchentreff der internationalen Zulieferbranche für den Off Highway-Sektor, der in diesem Jahr unter dem Leitthema "Touch smart Efficiency" steht. Die große Vielfalt an unterschiedlichen Arbeitsmaschinen in der Land-, Forst- und Bauwirtschaft führt zu einem hohen Bedarf an modularen und flexiblen Lösungen. „So lassen sich neue Funktionen für den autonomen Betrieb einer Maschine Stück für Stück ergänzen – eine Entwicklung, die sich auch auf dem Messegelände in Hannover widerspiegelt“, gibt Kaiser einen Ausblick auf die Inhalte des B2B-Marktplatzes, der erneut im Rahmen der Weltleitmesse Agritechnica stattfindet.

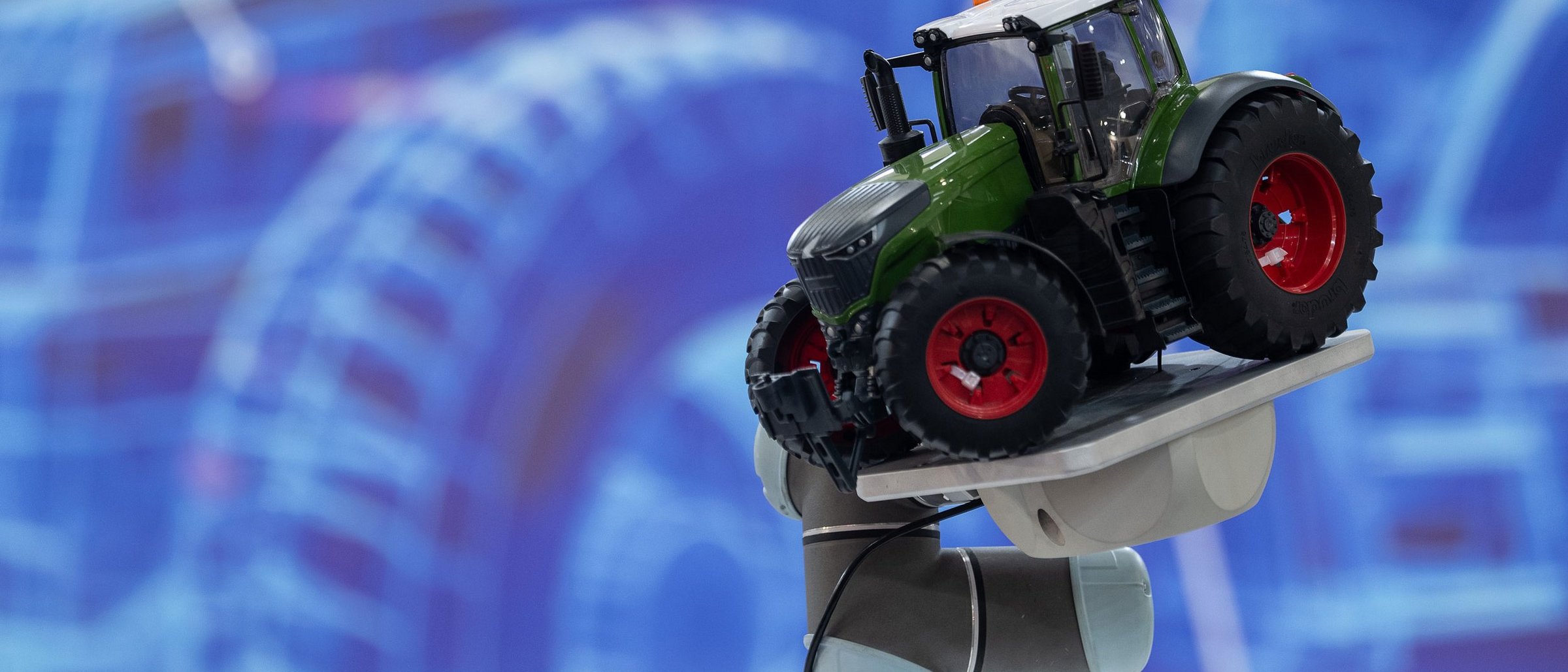

Foto: DLG

Zuverlässig unter rauen Bedingungen

Überträgt man die Trends im Off Highway-Sektor auf die Systemarchitektur einer mobilen Maschine, so bedeutet dies, dass mehr und mehr Daten aus einer steigenden Zahl an Sensoren verarbeitet werden müssen. Schlussendlich sollen diese Informationen dem Bediener in einer intuitiven Art und Weise präsentiert werden. Smarte und effektive HMI-Technologien sind dafür unerlässlich. Sie halten den Fahrer über die jeweilige Situation bei der Arbeit auf dem Laufenden. „Gefordert ist eine neue Art der Kommunikation zwischen Mensch und Maschine, bei der auch das Fahrzeug zunehmend eine aktive Position einnimmt“, erläutert Kaiser. Effektiv heißt in diesem Zusammenhang: Das Fahrzeug hilft dem Fahrer, die Situation zu verstehen, sorgt für Sicherheit und stellt alle benötigten Informationen zur Verfügung, ohne ihn zu überfordern. HMI-Lösungen, die auf der SYSTEMS & COMPONENTS im Mittelpunkt stehen, liefern kontinuierliches Feedback über wichtige Betriebsdaten wie Geschwindigkeit, Treibstoffverbrauch, Ernteertrag und Maschinenstatus. Dies ermöglicht es, im Cockpit informierte Entscheidungen zu treffen und effizienter zu arbeiten.

Hinzu kommt: Mobile Arbeitsmaschinen werden immer häufiger auch aus der Ferne gesteuert. Für die menschlichen Bediener ist es in diesen Fällen eine besondere Herausforderung, den Überblick über Maschine und Umgebung zu wahren. Im Fokus der jüngsten Entwicklungen stehen deshalb Extended-Reality-Technologien (XR). Die digitale Erweiterung der menschlichen Sinnesorgane soll die Interaktion mit der Maschine auf ein neues Level heben. Für Christiana Seethaler, Vice President Product Development bei TTControl, ist die Integration von XR-Technologien in die HMI- Produkte der „nächste Schritt zur Schaffung von intelligenteren, verlässlicheren Off Highway-Maschinen.“ Das Prinzip dahinter: XR-Technologien zeigen den Maschinenstatus im unmittelbaren Blickfeld des Fahrers, haptisches Feedback kann spürbare Signale schicken, etwa über einen Joystick. Zusätzlich machen akustische Signale auf Gefahren aufmerksam.

Arbeitsmaschinen für Menschen "erlebbar" machen

In Kombination mit externen Sensoren können derartige XR-Tools dabei helfen, Hindernisse und gefährliche Umgebungsfaktoren zu identifizieren. Das kann nicht nur die Sicherheit verbessern, sondern steigert durch vorausschauendes Arbeiten auch die Effizienz. Allerdings: „Die XR-Technologie muss intuitiv genug sein, um einen niederschwelligen Einsatz zu ermöglichen,“ erklärt Martijn Rooker, Innovation Projects & Funding Manager bei TTControl. „Deswegen wenden wir im Projekt TheiaXR einen menschenzentrierten, Szenario-basierten Co-Design- Ansatz an. Das bedeutet, dass wir Erfahrungen von echten Endnutzern und Industrieunternehmen mit einbeziehen, um sicherzustellen, dass alle entwickelten Lösungen so intuitiv und nutzerfreundlich wie möglich sind“, so Rooker, der das europäische Forschungsprojekt koordiniert.

Ziel ist es, das "Unsichtbare" sichtbar zu machen und die Wahrnehmung der Bediener im Cockpit digital zu erweitern, ohne deren Leistungsfähigkeit einzuschränken. Das Konsortium besteht aus elf Partnern, zu denen auf wissenschaftlicher Seite auch die TU Dresden, die TU Graz, die Universität Luxemburg sowie das finnische Forschungsinstitut VTT zählen. Aktuell wird TheiaXR in drei Szenarien getestet, in denen mobile Maschinen zum Einsatz kommen: Pistenpräparation, Logistik und Baugewerbe. Gemeinsam mit den Partnern will man etwa eine Lösung finden, Gasleitungen und Stromkabel mithilfe von virtueller Realität darzustellen, da diese bei Bauarbeiten immer wieder zerstört werden. Die Informationen zu Tiefe und Verlauf derartiger Leitungen könnten mit der Technologie im Sichtfeld des Maschinenführers abgebildet werden, etwa durch eine Projektion auf der Cockpitscheibe.

Sensorfusion sorgt für mehr Sicherheit

Eine leistungsstarke Umfeldsensorik liefert nicht nur einen wichtigen Baustein zur Automatisierung mobiler Arbeitsmaschinen – sie trägt auch maßgeblich dazu bei, ihren Einsatz sicherer zu gestalten. Einen Schwerpunkt der SYSTEMS & COMPONENTS bilden folglich Lösungen zur Unfallvermeidung. Die Technologielieferanten sehen sich dabei mit extrem unterschiedlichen Umgebungsbedingungen konfrontiert. Starke Kontraste, Gegenlicht und Dämmerung stellen die Kamerasysteme vor hohe Herausforderungen. Dies ist ein Grund, warum mehrere Sensorausführungen wie LiDAR, Ultraschall oder Radar in Kombination mit RGB- oder Infrarotkameras zum Einsatz kommen. Durch eine elektronische Fusion der Sensordaten werden die Vorteile der unterschiedlichen Sensorprinzipien kombiniert und so die Zuverlässigkeit des Assistenzsystems erhöht. So lassen sich Arbeitszyklen schneller, effektiver und sicherer durchführen, was letztlich Zeit und Kosten spart.

Foto: DLG

Modere Ultraschallsysteme ermöglichen mit ihren bis zu zwölf Sensoren eine 360-Grad-Rundumsicht. Je nach Konfiguration messen die Sensoren nur die reine Distanz oder bieten zusätzlich eine Objektlokalisierung. Dazu bestimmt ein Algorithmus die Position des Objekts im Detektionsraum mithilfe der Triangulation. Die Safety-Zertifizierung nach ISO 25119 ermöglicht einer derartigen Lösung die Integration in ein übergeordnetes System zur Umfelderkennung, das die Anforderungen der funktionalen Sicherheit für landwirtschaftliche Maschinen und Traktoren erfüllen muss. Hierzu zählen beispielsweise Anfahrtskontrollen oder Notbremsfunktionen für langsam fahrende Maschinen.

Kollisionswarnung für präziseres Manövrieren

Ein Beispiel für die elektronische Fusion der Sensordaten und die daraus resultierende erhöhte Leistungsfähigkeit der Assistenzsysteme ist das Collision Avoidance System (CAS) von Bosch Rexroth. Auf Basis einer präzisen Umfelderkennung mittels Radar, Ultraschall und Smart Kameras warnt es das Bedienpersonal von Baggern, Radladern und anderen Maschinen intuitiv per Vibration am Joystick vor drohenden Zusammenstößen. Art und Intensität des haptischen Feedbacks informieren über die Objektentfernung. Wird die Maschine mit zwei Joysticks bedient, kann das System durch Vibration des jeweiligen Joysticks die Richtung vermitteln, aus der sich das Objekt nähert.

Anders als bei einem rein visuellen oder akustischen Feedback bleibt die Aufmerksamkeit nahezu uneingeschränkt beim Arbeitsvorgang, was wichtige Reaktionszeit spart. Auch bei lauten Umgebungsgeräuschen und ohne Blick auf das Display kommt die Warnung direkt in den Händen des Fahrers an. Für höhere Automationsstufen besteht zudem die Option zum automatischen Bremseingriff über ein elektrohydraulisch gesteuertes Fremdkraftbremsventil – erfolgt keine rechtzeitige Reaktion auf die Warnung, wird der erforderliche Bremsdruck automatisch aufgebaut.

Assistenzfunktionen für mehr Produktivität

Der haptische Kollisionsschutz ist nur ein Beleg dafür, wie modulare Assistenzsysteme die Sicherheit im Arbeitsumfeld erhöhen. Stammen derartige Informationen heute noch überwiegend von den Kameras und Sensoren, die an der Maschine selbst montiert sind, so werden zukünftig auch Daten, die vom Umfeld, beispielsweise von anderen Fahrzeugen, von Robotern und Drohnen erzeugt werden, in einem intuitiven Lagebild für den Bediener zusammengefasst werden. Das im rheinischen Revier angesiedelte Projekt "Off Highway Twins 2" (OHT-2) greift diesen Ansatz auf. Durch die Fusion von Geo-Daten aus der Cloud sollen mit Sensor- und Telemetriedaten mittels Modellbildung, Sensordatenfusion und KI flächendeckende und detaillierte Modelle von Infrastrukturobjekten und ihrer Umgebung, die sogenannten Off-Highway Twins, in Echtzeit abgeleitet werden. So ließe sich aus den Bewegungs- und Antriebsdaten beispielsweise auslesen, wie viel Material ein Bagger bewegt hat und im Geländemodell direkt vermerken, wo der Aushub entstanden ist.

„Die denkbaren Szenarien und der Mehrwert solcher Informationen sind ein Schlüssel zur Produktivitätssteigerung für diverse Einsatzbereiche in der Land-, Forst- und Bauwirtschaft“, betont Petra Kaiser. All das zeige: „Autonome Technologien und Assistenzsysteme, wie sie vom 9. bis 15. November in Hannover zu sehen sind, punkten durch verbesserte Abläufe, präziseres Arbeiten und erhöhte Sicherheit. Arbeitsvorgänge im Off-Highway-Umfeld lassen sich so exakt planen, und aufeinander abstimmen“, so die die Brand Managerin der SYSTEMS & COMPONENTS.